强化学习规则奖励机制(Rule

利用奖励机制强化良好习惯 #生活知识# #生活心理学# #生活习惯改善# #自我管理能力培养#

1. 简介

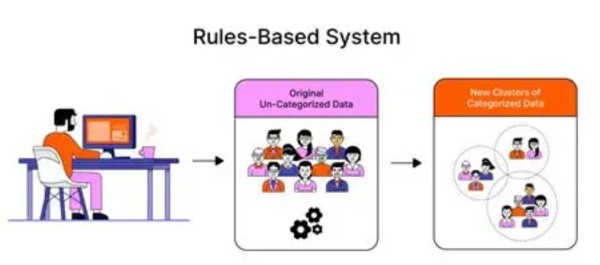

在强化学习的世界里,如何让AI模型学会"做正确的事"一直是个核心挑战。传统的训练方法往往依赖人类反馈来指导模型学习,但这不仅耗时耗力,还容易引入主观偏差。随着AI能力的提升,一种更高效、更客观的训练方法正在崭露头角——规则奖励机制(Rule-based Reward)。这种方法通过预定义的明确规则自动生成奖励信号,让模型在数学证明、代码编写等有明确答案的任务中表现更加精准。本文将带你从零开始理解这一技术,通过具体实例和可执行代码,一步步掌握如何设计、实现和应用规则奖励机制。

2. 什么是规则奖励机制

规则奖励机制是强化学习中的一种特殊奖励设计方法,它通过预定义的、可计算的规则来自动评估模型输出的正确性,并据此生成奖励信号。与依赖人类判断的传统方法不同,规则奖励机制完全基于任务本身的客观标准进行评分。

让我们用一个简单的例子来理解:假设我们要训练一个模型解一元二次方程 ax^2 + bx + c = 0。使用规则奖励机制时,我们可以编写一个验证函数,检查模型输出的解是否满足原方程。如果满足,给予正奖励;否则,给予负奖励或零奖励。

规则奖励机制的核心特征包括:

自动化评分能力:无需人工干预,系统能自动判断输出是否符合预设规则 客观一致性:相同的输出在相同条件下总是获得相同的评分 任务针对性:规则设计紧密围绕任务目标,确保模型学习到真正有价值的行为 高效可扩展:一旦规则建立,可以无限次应用于新样本的评估在实际应用中,规则奖励机制特别适合那些有明确正确答案或可验证标准的任务领域,如数学问题求解、代码生成和逻辑推理等。许多现代语言模型在训练过程中都采用了基于规则的奖励系统来强化模型在这些任务中的准确性。

3. 规则奖励与传统奖励机制的区别

要真正理解规则奖励机制的价值,我们需要将其与传统的人类反馈强化学习(RLHF)进行对比。这两种方法在数据来源、实施成本和可扩展性方面有着本质区别。

3.1 数据来源差异

在RLHF中,奖励信号来源于人类标注者的主观评价。例如,当模型生成一段文本时,人类需要判断这段文本的质量、相关性和准确性。这种方式虽然灵活,但容易受到个人偏见和情绪的影响。

相比之下,规则奖励机制的奖励信号完全来源于预定义的客观规则。以代码生成任务为例,规则奖励系统会直接编译执行生成的代码,并根据测试用例的通过情况给出精确评分,而不是依赖人类对代码"看起来是否专业"的主观判断。

3.2 实施成本对比

实施成本是规则奖励机制最具吸引力的优势之一。RLHF需要持续投入大量人力资源进行标注,随着任务复杂度增加,成本呈指数级上升。而规则奖励机制虽然前期需要投入时间设计验证规则,但一旦建立,后续评估几乎不产生额外成本。

我们可以用一个简单的表格来比较两者的成本结构:

评估维度 规则奖励机制 人类反馈强化学习(RLHF) 初期投入 高(需开发规则系统) 低(只需简单标注指南) 后期维护 低(规则稳定后几乎无需调整) 高(需持续管理标注团队) 评估速度 极快(毫秒级自动评估) 慢(依赖人工处理速度) 评估一致性 非常高(相同输入总得相同输出) 中等(受标注者状态影响) 任务适用性 限于有明确验证标准的任务 几乎适用于所有任务3.3 可扩展性分析

在大规模模型训练中,可扩展性至关重要。规则奖励机制在这方面具有明显优势。

规则奖励机制的可扩展性体现在:

并行评估:可以同时评估大量模型输出 即时反馈:模型能立即获得评估结果,加速学习过程 无限样本:只要有规则,就能无限生成训练样本规则基础奖励函数由于奖励信号发挥稳定,往往能提升强化学习过程的稳定性,使模型能够高效地学习解决复杂数学问题、逻辑推理和编码任务。

4. 规则奖励的核心工作原理

理解规则奖励机制的工作原理,关键在于把握"规则系统如何将任务知识转化为可计算的奖励信号"这一核心过程。让我们通过一个概念框架来详细解析。

4.1 规则系统的整体架构

规则奖励系统通常包含三个核心组件:

规则定义层:描述任务领域的专业知识和验证标准 验证执行层:接收模型输出,应用规则进行验证 奖励计算层:根据验证结果生成量化奖励值这个过程可以用以下数学表达式概括:

R(s_t, a_t) = f(\text{validate}(a_t, \text{rules}))

其中:

R(s_t, a_t) 是在状态 s_t 下执行动作 a_t 获得的奖励 \text{validate}(\cdot) 是验证函数,检查动作是否符合规则 f(\cdot) 是将验证结果映射为奖励值的函数4.2 规则验证的具体流程

让我们以一个具体的代码生成任务为例,详细说明规则验证的完整流程:

输入接收:模型生成一段Python代码作为对特定编程问题的回答 规则匹配:系统根据问题类型选择相应的验证规则集 多级验证: 语法检查:验证代码是否符合Python语法规则 编译执行:尝试编译并执行代码 功能测试:用预定义的测试用例验证代码功能 性能评估:检查代码的时间/空间复杂度 结果分析:汇总各级验证结果 奖励计算:根据验证结果计算最终奖励值这种分层验证机制确保了奖励信号的准确性和全面性。

4.3 奖励信号的设计原则

有效的规则奖励机制需要精心设计奖励信号,使其既能准确反映任务目标,又能引导模型有效学习。以下是几个关键设计原则:

稀疏性与密集性的平衡:完全稀疏的奖励(仅在完全正确时给分)会使学习效率低下,而过于密集的奖励可能误导模型 阶段性奖励:对于多步骤任务,可以设计中间步骤奖励 惩罚与奖励的合理比例:避免过度惩罚导致模型过于保守 可微性考虑:在可能的情况下,设计具有一定"可微性"的奖励函数,便于基于梯度的优化一个简单的奖励函数示例:

R = \begin{cases} 1.0, & \text{if output is fully correct} \\ 0.5, & \text{if output is partially correct} \\ 0.0, & \text{otherwise} \end{cases}

5. 规则设计的基本原则与方法

设计有效的规则系统是规则奖励机制成功的关键。好的规则既不能过于宽松导致模型"钻空子",也不能过于严格限制模型的创造性。本节将系统介绍规则设计的核心原则和方法。

5.1 规则设计的四大核心原则

明确性:规则必须清晰无歧义,确保不同情况下能产生一致的判断 覆盖性:规则应尽可能覆盖任务的各种可能情况,包括边界条件 可计算性:规则必须能够通过算法自动验证,不能包含主观判断 抗欺骗性:规则应能防止模型通过"奖励黑客"行为获得不正当高分这些原则相互关联且有时存在权衡。例如,提高覆盖性可能会降低可计算性,增强抗欺骗性可能会使规则过于复杂。

5.2 针对不同任务的规则设计方法

不同任务类型需要不同的规则设计策略。让我们分别探讨数学、代码和逻辑推理任务的规则设计方法。

数学任务规则设计对于数学问题求解,规则设计应关注:

最终答案验证:检查答案是否满足问题要求 中间步骤检查:验证推理过程的逻辑正确性 格式合规性:确保答案符合指定格式要求以解方程为例,我们可以设计如下规则:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

查看代码

认证以查看完整的代码示例并获取更多技术资源

代码任务规则设计代码生成任务的规则设计更为复杂,需要考虑多个层面。下面是一个基础的代码验证函数:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

110

111

查看代码

认证以查看完整的代码示例并获取更多技术资源

逻辑推理任务规则设计逻辑推理任务的规则设计需要特别关注推理链的连贯性和正确性:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

查看代码

认证以查看完整的代码示例并获取更多技术资源

6. 数学任务中的规则构建实例

数学问题求解是规则奖励机制的理想应用场景,因为数学问题通常有明确的正确答案和可验证的解题过程。本节将详细展示如何为不同类型的数学问题设计规则。

6.1 代数方程求解规则设计

考虑一元二次方程 ax^2 + bx + c = 0 的求解任务。一个完整的规则系统应包含以下验证层次:

答案正确性验证: 检查解是否满足原方程:a \cdot x^2 + b \cdot x + c \approx 0 验证解的个数是否符合判别式 \Delta = b^2 - 4ac 的预期 解题步骤验证: 检查是否正确应用求根公式:x = \frac{-b \pm \sqrt{\Delta}}{2a} 验证中间计算是否准确 特殊情况处理: 当 \Delta < 0 时,检查是否提到了复数解 当 a = 0 时,检查是否识别出这是一次方程以下是一个验证函数实现:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

查看代码

认证以查看完整的代码示例并获取更多技术资源

7. 代码任务中的规则构建实例

代码生成是规则奖励机制最成功的应用领域之一,因为代码的正确性可以通过编译执行和测试用例进行客观验证。本节将深入探讨如何构建多层次的代码验证规则。

7.1 代码验证的四个层次

一个完善的代码验证系统应该包含四个层次的检查:

语法正确性:代码是否符合编程语言的语法规则 编译/解释通过性:代码是否能成功编译或解释执行 功能正确性:代码是否能正确解决给定问题 质量指标:代码的时间复杂度、空间复杂度和可读性等让我们通过一个具体的编程问题来展示这四个层次的验证:

问题:编写一个Python函数,计算斐波那契数列的第n项。

语法和编译验证首先,我们需要验证代码的基本语法正确性:

1

2

3

4

5

6

7

8

9

10

查看代码

认证以查看完整的代码示例并获取更多技术资源

功能测试验证功能测试是代码验证的核心,需要设计全面的测试用例:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

查看代码

认证以查看完整的代码示例并获取更多技术资源

测试用例设计策略测试用例的质量直接决定了规则系统的有效性。一个好的测试用例集应该包含:

基本案例:常规输入,验证基本功能 边界案例:最小值、最大值等边界条件 异常案例:非法输入,验证错误处理 性能案例:大输入,验证时间/空间复杂度以下是一个斐波那契问题的测试用例设计示例:

1

2

3

4

5

6

7

8

9

10

11

12

查看代码

认证以查看完整的代码示例并获取更多技术资源

7.2 完整的代码验证流程

将上述组件组合起来,形成一个完整的代码验证流程:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

查看代码

认证以查看完整的代码示例并获取更多技术资源

8. 规则奖励的实现流程

了解了规则设计的原理和实例后,现在让我们看看如何将规则奖励机制集成到实际的强化学习系统中。本节将详细说明从零开始实现规则奖励系统的完整流程。

8.1 系统架构设计

一个典型的规则奖励系统包含以下组件:

1

2

3

4

5

6

7

8

9

10

11

查看代码

认证以查看完整的代码示例并获取更多技术资源

这个流程中,模型生成输出后,规则验证引擎对其进行多级验证,然后计算奖励值,最后用于策略优化。

8.2 实现步骤详解

步骤1:定义任务和收集数据首先,明确你要解决的任务类型,并收集或创建相关的训练数据:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

查看代码

认证以查看完整的代码示例并获取更多技术资源

步骤2:开发规则验证引擎根据任务类型,开发相应的规则验证组件:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

查看代码

认证以查看完整的代码示例并获取更多技术资源

步骤3:集成到强化学习框架将规则验证引擎集成到强化学习训练循环中:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

查看代码

认证以查看完整的代码示例并获取更多技术资源

9. 规则验证与质量评估方法

设计好的规则只是第一步,确保规则本身的质量和可靠性同样重要。本节将介绍如何系统评估和验证规则系统的有效性。

9.1 规则质量评估的四个维度

评估规则质量应从以下四个关键维度进行:

准确性:规则是否能正确区分正确和错误的输出 覆盖率:规则是否覆盖了任务的大多数情况 一致性:相同输入是否总是产生相同评估结果 抗欺骗性:规则是否能防止模型通过"奖励黑客"行为获得不正当高分以下是一个评估框架的实现:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

查看代码

认证以查看完整的代码示例并获取更多技术资源

9.2 对抗性测试方法

对抗性测试是验证规则系统鲁棒性的关键方法。我们需要主动寻找规则中的漏洞,模拟模型可能的"钻空子"行为。

以下是一些常见的对抗性测试策略:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

查看代码

认证以查看完整的代码示例并获取更多技术资源

10. 规则奖励的局限性与挑战

尽管规则奖励机制有许多优势,但它也面临一些实际挑战。了解这些局限性对于正确应用该技术至关重要。

10.1 规则设计的复杂性

设计全面而精确的规则系统是一项复杂的工程任务。随着任务复杂度增加,规则系统的复杂度呈指数级上升。

以代码验证为例,一个完善的验证系统需要考虑:

语法正确性 编译通过性 功能正确性 边界条件处理 异常情况处理 时间/空间复杂度 代码风格和可读性每个方面都需要精心设计规则,而且这些规则之间可能存在交互和冲突。

10.2 规则稀疏性问题

在许多任务中,规则只能提供稀疏的奖励信号——要么完全正确,要么完全错误。这种二元化的奖励信号会使学习过程效率低下,因为模型很难从"完全错误"的反馈中获得有用的指导。

数学上,稀疏奖励可以表示为:

R(s,a) = \begin{cases} 1, & \text{if } \text{validate}(a) = \text{True} \\ 0, & \text{otherwise} \end{cases}

这种奖励函数在大多数状态下都为0,导致策略梯度估计的方差很大,学习效率低下。

10.3 边缘情况覆盖难题

规则系统很难覆盖所有可能的边缘情况。在实际应用中,模型可能会找到规则未覆盖的"灰色地带",产生看似合理但实际错误的输出。

例如,在数学问题中:

特殊函数的定义域限制 复数解的处理 无穷大和无穷小的特殊情况在代码生成中:

特定平台的边界行为 浮点数精度问题 并发和竞态条件11. 解决规则局限性的技术策略

面对规则奖励机制的局限性,研究人员开发了多种技术策略来提高系统的鲁棒性和适应性。本节将介绍几种实用的解决方案。

11.1 多层次奖励设计

多层次奖励设计通过将奖励信号分解为多个层次,缓解稀疏性问题:

R(s,a) = \sum_{i=1}^{n} w_i \cdot R_i(s,a)

其中 R_i 是第 i 层次的奖励,w_i 是相应的权重。

以数学问题求解为例,可以设计以下层次:

格式合规性(权重 0.1):答案是否符合指定格式 中间步骤正确性(权重 0.3):关键推理步骤是否正确 最终答案正确性(权重 0.6):最终答案是否正确这种设计使模型即使在未完全解决问题时也能获得部分反馈,加速学习过程。

11.2 渐进式规则引入

渐进式规则引入策略建议从简单规则开始,随着模型能力提升逐步增加规则复杂度:

阶段1:仅验证最终答案正确性 阶段2:添加基本格式检查 阶段3:引入中间步骤验证 阶段4:增加性能和质量指标这种方法可以避免早期训练中因规则过于严格而导致的学习困难。

12. 规则奖励与模型行为的关联分析

规则奖励机制不仅是一种训练技术,它还深刻影响着模型的学习行为和最终表现。本节将深入探讨规则奖励如何塑造模型行为。

12.1 奖励信号与推理深度的关系

奖励信号的设计直接影响模型的推理深度。当奖励仅关注最终答案时,模型倾向于"猜测"答案而不展示推理过程;而当奖励包含中间步骤验证时,模型会学习生成更详细的推理链。

我们可以用以下数学模型描述这种关系:

D = \alpha \cdot R_{\text{steps}} + \beta \cdot R_{\text{answer}} + \epsilon

其中:

D 是模型的推理深度 R_{\text{steps}} 是步骤奖励的权重 R_{\text{answer}} 是答案奖励的权重 \alpha, \beta 是系数 \epsilon 是随机误差实验表明,当 \alpha > \beta 时,模型倾向于生成更长的推理链;当 \beta > \alpha 时,模型更关注快速得到答案。

12.2 规则严格性与探索-利用平衡

规则的严格性影响模型的探索-利用平衡:

严格规则:限制模型探索空间,可能导致过早收敛到次优解 宽松规则:允许更多探索,但可能学习到不精确的行为理想的规则设计应在严格性和灵活性之间取得平衡,随着训练进行动态调整规则严格度。

13. 规则奖励的未来发展与研究方向

规则奖励机制虽然已经取得显著成果,但仍在不断发展。本节将概述当前的研究趋势和未来发展方向。

13.1 规则自动化生成

当前规则设计主要依赖人工,未来趋势是开发规则自动化生成技术:

从示范数据中学习规则:通过分析高质量示范,自动提取验证规则 基于形式化方法的规则生成:利用形式化验证技术自动生成精确规则 规则模板学习:学习规则的通用模式,适应新任务13.2 自适应规则系统

未来的规则系统将更加自适应,能够根据任务难度和模型能力动态调整:

难度感知规则:根据问题难度自动调整评分标准 模型能力感知:根据模型当前水平调整规则严格度 上下文感知规则:考虑问题上下文调整验证标准13.3 规则与人类反馈的融合

未来的研究将探索规则奖励与人类反馈的有机结合:

混合奖励系统:对可验证任务使用规则奖励,对主观任务使用人类反馈 规则引导的人类标注:利用规则预筛选样本,提高人类标注效率 人类修正规则系统:允许人类专家修正和优化自动规则14. 总结

规则奖励机制为强化学习提供了一种高效、客观的训练方法,特别适用于有明确验证标准的任务。通过预定义的规则自动评估模型输出,这种方法避免了人工标注的高成本和主观性,同时提供了稳定可靠的训练信号。

我们从基础概念出发,逐步深入探讨了规则设计原则、实现方法和实际应用。通过具体的代码示例,你应该已经掌握了如何为数学、代码和逻辑推理任务构建有效的规则系统。

尽管规则奖励机制存在一些局限性,如规则设计的复杂性和对开放性任务的适用性限制,但通过多层次奖励设计和渐进式规则引入等策略,我们可以显著提高系统的鲁棒性和适应性。

规则奖励机制提供了一种将领域专业知识直接编码为训练信号的有效途径,使我们能够更有针对性地塑造AI模型的行为,使其在特定任务上达到更高的专业水平。通过实践本文介绍的方法,你已经迈出了掌握这一重要技术的第一步。

网址:强化学习规则奖励机制(Rule https://c.klqsh.com/news/view/352169

相关内容

强化学习和平精英职业赛规则详解(从比赛流程到奖励机制全面解析)

游戏设计师揭秘:利用游戏的上瘾机制,4招让孩子对学习上瘾

企业管理的激励和激励机制.pptx

如何建立明确学习目标,制定学习计划,避免盲目学习疲劳

学习进步奖获奖感言(八篇)

学习的机制

如何建立自我激励的机制 – PingCode

《原子习惯》:小习惯改变大人生

职场技能提升中的学习动机培养方法.docx